1762: [문제2] 렐?루

메모리제한:128 MB

시간제한:1.000 S

Judge Style:Text Compare

만든사람:

제출:5

통과:3

문제 설명

머신러닝이나 인공신경망을 공부하다 보면 한 번쯤은 ‘활성화 함수’라는 단어를 본 적이 있을 것이다. 인공지능은 뇌 속 뉴런 신호 전달 방식을 컴퓨터에 접목시킨 컴퓨팅 모델이다.

서로 연결된 처리 소자, 일명 '뉴런'이라는 것이 있으며 이들이 서로 협력하여 출력 결과 값을 도출해낸다.

이때, 활성화 함수는 데이터 가중 합을 출력 신호로 변환하는 함수로 입력된 데이터를 활성화할지 말지를 결정하는 중요한 역할을 한다.

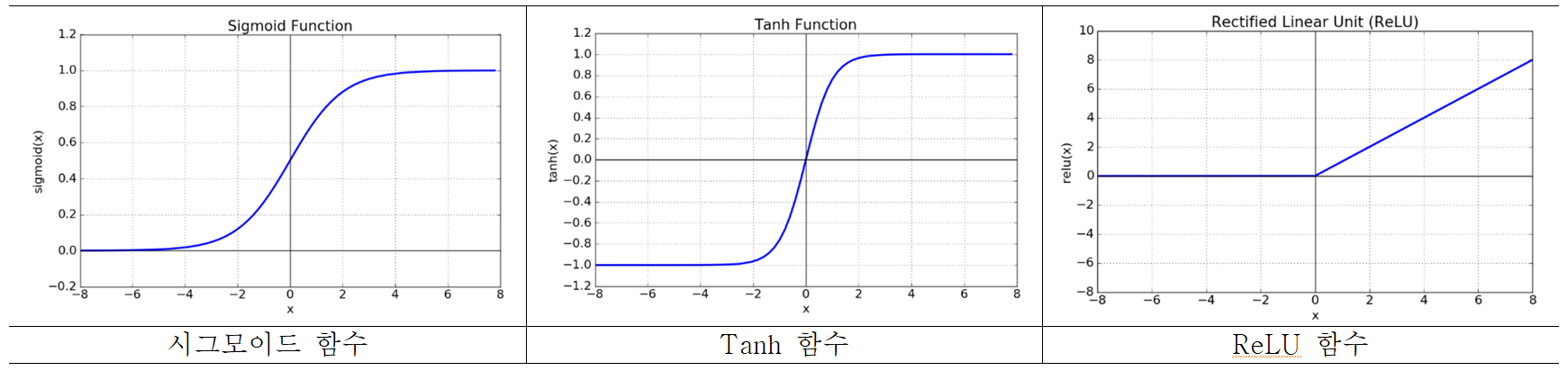

활성화함수는 크게 SIgmoid 함수, Tanh 함수, ReLU 함수로 나뉘어진다.

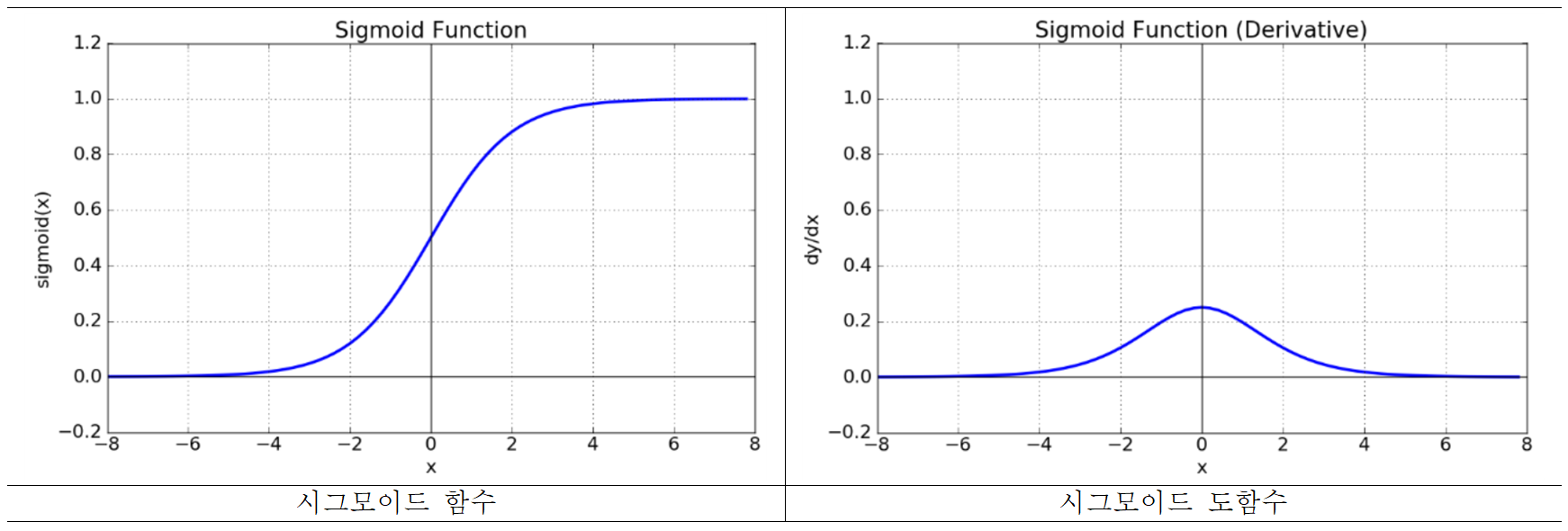

그 중에서 시그모이드 함수는 Logistic 함수라고 불리기도 하며, 그림처럼 입력되는 x의 값에 따라 0~1의 값을 출력하는 S자형 함수이다. 숫자가 아무리 작건 크건 0과 1에 근접한 값에 수렴한다.

sigmoid 함수는 모든 실수 값을 0보다 크고 1보다 작은 미분 가능한 수로 변환하는 특징이 있기

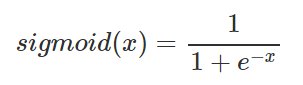

때문에, 로지스틱 회귀에 많이 쓰인다. sigmoid 함수의 구현은 생각보다 쉽다. 아래 수식을 프로그램으로 구현해주기만 하면 된다.

sigmoid(x)의 값을 출력해보자.

입력 설명

입력 값(x)이 주어진다.

(-8 ≤ x ≤ 8)

출력 설명

sigmoid(x)의 결과 값을 출력한다.

(소수점 이하 7자리에서 반올림하여 6자리까지 표현한다.)

입력 예시 Copy

8출력 예시 Copy

0.999665도움

[입력예시2]

-5

[출력예시2]

-5

[출력예시2]

0.006693